Apples neue Forschung, ausführlich beschrieben in „Humanoid Policy ∼ Human Policy“, stellt eine bahnbrechende Methode zur Ausbildung humanoider Roboter vor. Dieser innovative Ansatz, eine Zusammenarbeit mit Top-Universitäten, nutzt menschliche Demonstrationen aus der ersten Person, die häufig mit einem Apple Vision Pro aufgenommen werden, um das Lernen von Robotern effizienter und erschwinglicher zu machen. Es ist ein bedeutender Fortschritt gegenüber den traditionellen, komplexen Methoden zum Unterrichten von Robotern.

Die Kernidee besteht darin, egozentrische menschliche Demonstrationen zu sammeln, bei denen es sich um Videos von Menschen handelt, die Aufgaben aus ihrer eigenen Perspektive ausführen. Dies steht in krassem Gegensatz zu dem teuren und arbeitsintensiven Prozess, ausschließlich robotergenerierte Trainingsdaten zu sammeln. Durch die Kombination von über 25.000 menschlichen und 1.500 Roboterdemonstrationen in einem einheitlichen Datensatz namens PH2D möchte Apple eine einzige KI-Richtlinie schaffen, die sowohl menschliche als auch Roboteraktionen versteht und so die Effizienz erheblich verbessert.

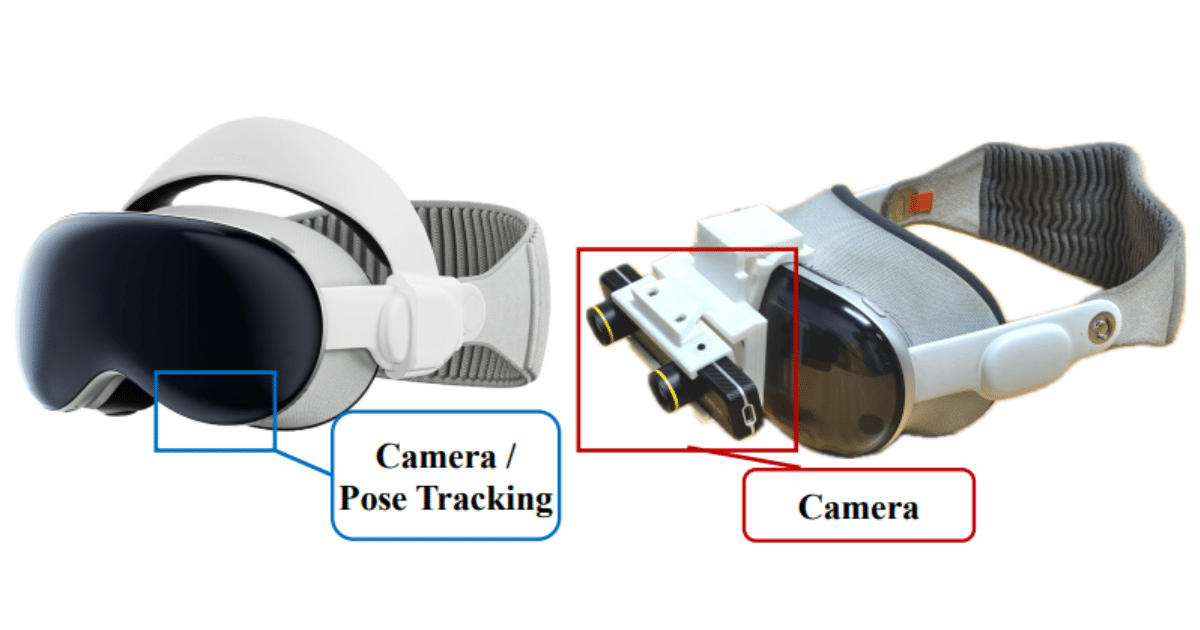

Um dies zu erreichen, hat Apple eine spezielle App für das Vision Pro entwickelt. Es nutzt die Kamera des Headsets und ARKit, um präzise 3D-Kopf- und Handbewegungen zu erfassen und so die detaillierten Aktionsdaten bereitzustellen, die Roboter benötigen. Um dies zugänglich zu machen, hat Apple auch eine Halterung für eine ZED Mini-Stereokamera entwickelt, die eine ähnlich hochwertige Datenerfassung mit günstigeren Headsets wie dem Meta Quest 3 ermöglicht.

Diese neue Methode verbessert die Trainingseffizienz drastisch. Während die herkömmliche Teleoperation ewig dauern kann, zeichnet der Ansatz von Apple vollständige Demonstrationen in Sekunden auf, was die Kosten senkt und die Skalierbarkeit erhöht. Interessanterweise werden menschliche Demonstrationsvideos während des Trainings um den Faktor vier verlangsamt, um sich an die Robotergeschwindigkeit anzupassen, was den Lernprozess ohne zusätzliche Anpassungen vereinfacht.

Empfohlene Lektüre:Apple entwickelt Smart-Home-Roboter, erwartet sie aber nicht vor 2028

Das Herzstück dieses Systems ist das Human Action Transformer (HAT)-Modell. HAT verarbeitet sowohl menschliche als auch Roboterdemonstrationen in einem einheitlichen Format und lernt universelle Regeln für Manipulationsaufgaben. Dieser integrierte Ansatz ermöglicht es Robotern, neue und unbekannte Aufgaben effektiver zu meistern und benötigt dabei weniger Daten als herkömmliche reine Roboterschulungen.

Die Studie „Humanoid Policy ∼ Human Policy“ beleuchtet einen entscheidenden Moment in der KI und Robotik und zeigt, wie menschliche Erkenntnisse die Entwicklung hochentwickelter humanoider Roboter beschleunigen können.

Schauen Sie sich das vollständige Papier anHier.